IA en el borde después del “memory wall”: computación en memoria, aprendizaje compacto y flujos con LLM gobernados

El rendimiento de la IA está quedando condicionado por un cuello de botella muy concreto: mover datos entre cómputo y memoria. En despliegues IoT, ese “memory wall” se traduce en latencia, calor, consumo de batería y dependencia del cloud.

En paralelo, los LLM y los pipelines de RAG están entrando a operaciones. La ventaja no la tendrá quien “genere más”, sino quien combine IA en el borde eficiente con gobernanza estructural para mantener estabilidad, trazabilidad y seguridad ante el drift.

1) El “memory wall” ya es una restricción de producto en IoT

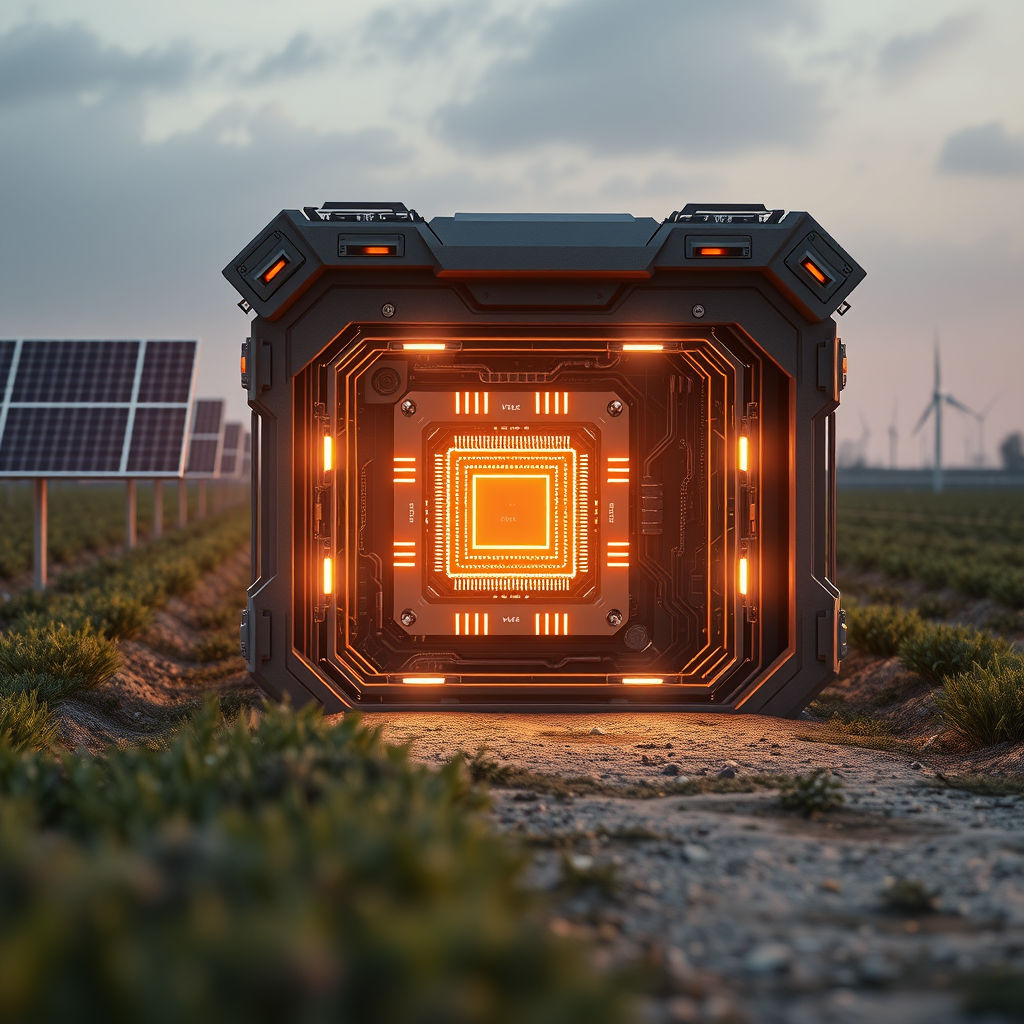

En industria, energía y agrotech, el mejor modelo suele ser el que corre donde nacen los datos. La IA en el borde reduce viajes a cloud computing, sostiene continuidad cuando la conectividad es intermitente y minimiza exposición de señales operativas sensibles.

Pero el borde paga un impuesto silencioso: gran parte de la energía no se va en multiplicaciones, sino en transportar activaciones y pesos entre procesador y memoria. Por eso la computación en memoria gana relevancia: busca ejecutar la operación central de redes neuronales (multiplicar y acumular) directamente donde residen los pesos.

Una línea prometedora es el uso de memorias resistivas capaces de representar múltiples estados estables y apilarse en 3D. En enfoques más nuevos, se evita el cambio ruidoso basado en “filamentos” y se conmuta un volumen completo del material entre estados de resistencia. A nivel sistema, esto apunta a:

- Pesos multi-nivel más estables, clave para operaciones paralelas tipo matriz.

- Menos fricción de integración con restricciones típicas de silicio embebido.

- Arreglos sin selectores, que facilitan densidad y apilado.

- Aprendizaje local, útil cuando el dispositivo necesita adaptarse sin depender del cloud.

En un ecosistema IoT, esto es estratégico: cambia cómo presupuestas energía y latencia entre sensado, inferencia y control, especialmente en nodos de monitoreo inteligente y mantenimiento predictivo.

2) Aprendizaje compacto en el borde: auto-supervisión sin sesgos

En el borde rara vez hay etiquetas perfectas. Las fallas no ocurren “a pedido”, y la anotación manual no escala. Por eso la auto-supervisión es tan valiosa: aprende representaciones desde señales crudas y luego se ajusta con pocos datos.

Un problema típico es el sesgo de augmentations: si siempre enmascaras lo más “obvio” del movimiento, el modelo se vuelve frágil ante patrones raros y ruido. En aprendizaje de acciones con esqueletos se está viendo una estrategia más balanceada: construir dos vistas enmascaradas complementarias para cubrir dinámicas de alta y baja saliencia, y luego alinear esas representaciones.

La lección práctica no es “usar esqueletos en todo”, sino replicar el enfoque:

- Representaciones que cubran todo el espectro espacio-temporal, no solo picos.

- Alineación ligera para que las vistas no diverjan.

- Destilación para llevar el modelo a hardware real, intercambiando un pequeño margen de precisión por velocidad y estabilidad.

- Complementar con técnicas de borde (cuantización, optimización de operadores) para cumplir SLAs.

Esto mejora despliegues en seguridad industrial, automatización de instalaciones y analítica operacional, donde la generalización vale más que una métrica puntual.

3) LLM en operaciones: RAG y los límites reales del razonamiento

Los LLM ya no son solo conversación: entran a soporte a decisiones, ejecución de runbooks y copilotos para operadores. En ese contexto, RAG es una pieza de control: restringe la generación a conocimiento vigente y autorizado.

Aun así, los fallos de razonamiento persisten. Análisis recientes ordenan estas fallas por tipos de razonamiento (práctico vs formal) y por causas: limitaciones intrínsecas, vacíos por dominio y problemas de robustez donde pequeños cambios de entrada alteran drásticamente la salida.

Para automatización, hay un punto crítico: la ejecución de largo horizonte puede degradarse por razones estructurales, no solo por “complejidad”. En tareas con muchos pasos dependientes, errores pequeños se acumulan. Por eso los sistemas tienden a segmentar la ejecución: más parecido a un grafo gobernado que a una sola cadena.

Patrones que aplicamos para que el razonamiento de LLM y RAG sea confiable en sistemas IoT + IA:

- Planes segmentados con checkpoints: etapas cortas con traspaso explícito de estado.

- Ejecución orientada a herramientas: preferir acciones deterministas sobre texto libre.

- Gating de recuperación: generar solo si el contexto es relevante, reciente y con permisos.

- Control multi-hipótesis con presupuesto: explorar al inicio y reducir a la ruta más sólida al subir la confianza.

- Salidas estructuradas con validación: rechazar respuestas que no cumplan esquema para workflows.

Cuándo gana la IA en el borde frente al cloud: Si la decisión es crítica en tiempo (parada de seguridad, control de actuadores), sensible en privacidad (telemetría de seguridad) o hay conectividad limitada (campos remotos y subestaciones), empuja inferencia a IA en el borde y usa cloud computing para aprendizaje de flota, auditoría y curación de RAG.

Este enfoque también encaja con ciberseguridad: menos acciones improvisadas, más pasos validados y mejor trazabilidad.

4) De señales de investigación a autonomía desplegable (y retorno)

La jugada estratégica es tratar IoT + IA como un lazo cerrado: sensar → inferir → decidir → actuar → aprender. Así, lo “nuevo” se convierte en palancas concretas.

- La computación en memoria importa porque puede bajar el costo de nodos Edge AI siempre encendidos para monitoreo inteligente.

- La auto-supervisión balanceada + destilación importa porque mantiene modelos pequeños, rápidos y robustos en dispositivos limitados.

- La gobernanza de LLM importa porque copilotos con RAG deben ser consistentes entre turnos, sitios y condiciones.

Para sistemas autónomos—como autonomus irrigation systems—el aprendizaje por refuerzo se vuelve más viable cuando los objetivos se pueden especificar con restricciones lógicas legibles (no solo recompensas paso a paso). Especificaciones temporales permiten expresar “haz X, luego mantén Y hasta Z” de forma cercana a requisitos operativos, reduciendo riesgo y acelerando iteraciones.

Además, las representaciones de conocimiento vuelven a ser centrales. Mantener grafos de activos, alarmas y dependencias crea una capa durable para RAG y workflows, especialmente en mantenimiento predictivo y respuesta a incidentes.

Conoce más sobre nuestro trabajo aplicado en IoT + IA

Metadata:

Title: IA en el borde, computación en memoria y RAG gobernado para IoT industrial

Description: Cómo superar el memory wall con computación en memoria, aprendizaje compacto y flujos LLM + RAG gobernados para automatización confiable.

Keywords: IA en el borde, ecosistema IoT, mantenimiento predictivo, RAG, razonamiento de LLM, computación en memoria